拳打Pika脚踢Gen-2!斯坦福李飞飞联合谷歌,AI文生视频大模型炸圈

2023-12-14 18:42:11 发布人:hao333 阅读( 1673)

文生视频工具扎堆爆发,视频的GPT时刻来了?作者 | 李水青编辑 | 漠影AI文生视频赛道正呈现出爆发之势!继本月AI文生视频工具Pika 1.0爆火出圈、Ge...

文生视频工具扎堆爆发,视频的GPT时刻来了?

作者 | 李水青

编辑 | 漠影

AI文生视频赛道正呈现出爆发之势!

继本月AI文生视频工具Pika 1.0爆火出圈、Gen-2效果大升级之后,斯坦福大学AI科学家李飞飞的团队也有了新动作!

智东西12月12日报道,今日,李飞飞及其学生团队与谷歌合作,推出了AI视频生成模型W.A.L.T。

▲李飞飞在社交平台X发声转发

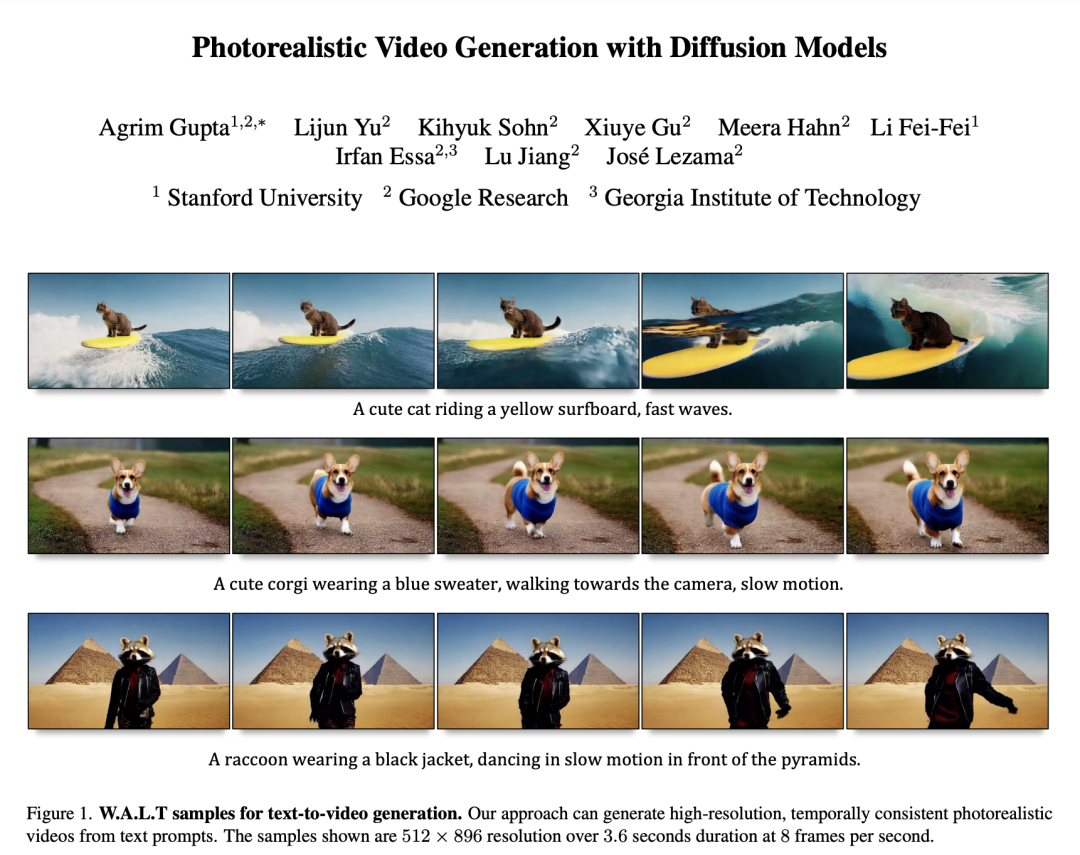

演示中,W.A.L.T可以通过自然语言提示,生成3秒长的每秒8帧、分辨率达512x896的逼真视频。

▲W.A.L.T的文生视频示例

W.A.L.T可以让一张静态图片变为一个的动态感十足的动图。

▲W.A.L.T的图生视频示例

W.A.L.T还可以用于生成3D摄像机运动的视觉效果。

▲W.A.L.T的3D视频生成示例

与爆火的Pika 1.0、Gen-2等同类工具类似,W.A.L.T采用扩散模型技术。

同时,W.A.L.T的创新之处在于,其将Transformer架构与潜在扩散模型相结合,在一个共享潜在空间中压缩图像和视频,从而降低计算要求,提高训练效率。

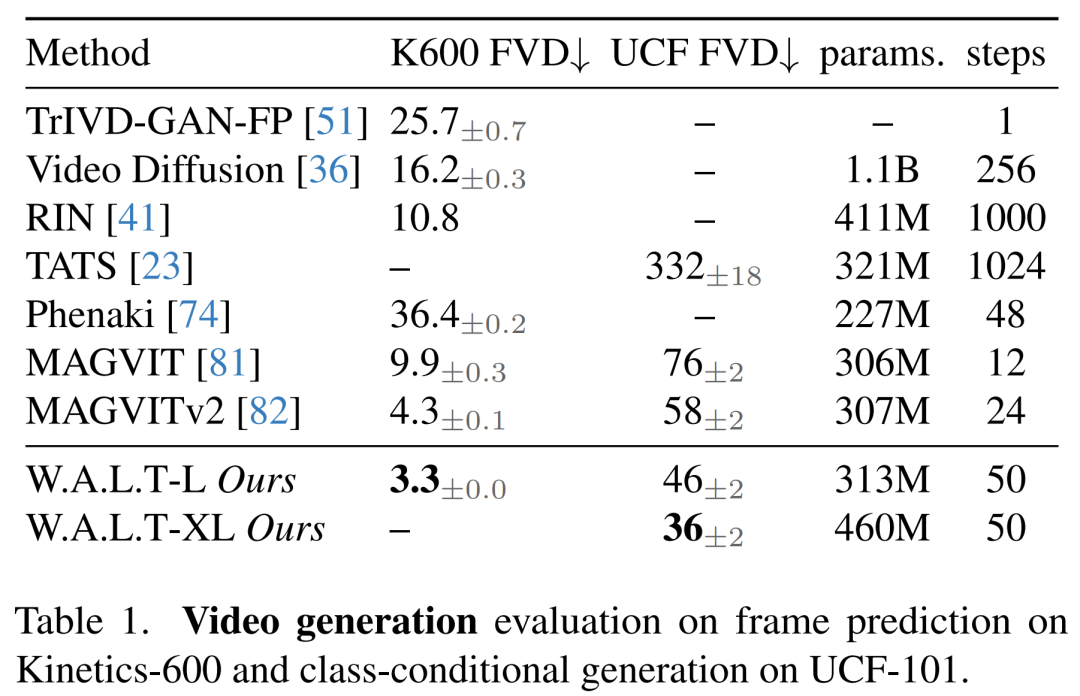

根据论文,W.A.L.T在视频生成基准UCF-101和Kinetics-600、图像生成基准ImageNet测试上实现了SOTA。

项目地址:

https://walt-video-diffusion.github.io/

论文地址:

https://walt-video-diffusion.github.io/assets/W.A.L.T.pdf

▲W.A.L.T相关论文截图

01 .

一句话生成3s视频,

高逼真、强动态、3D视觉

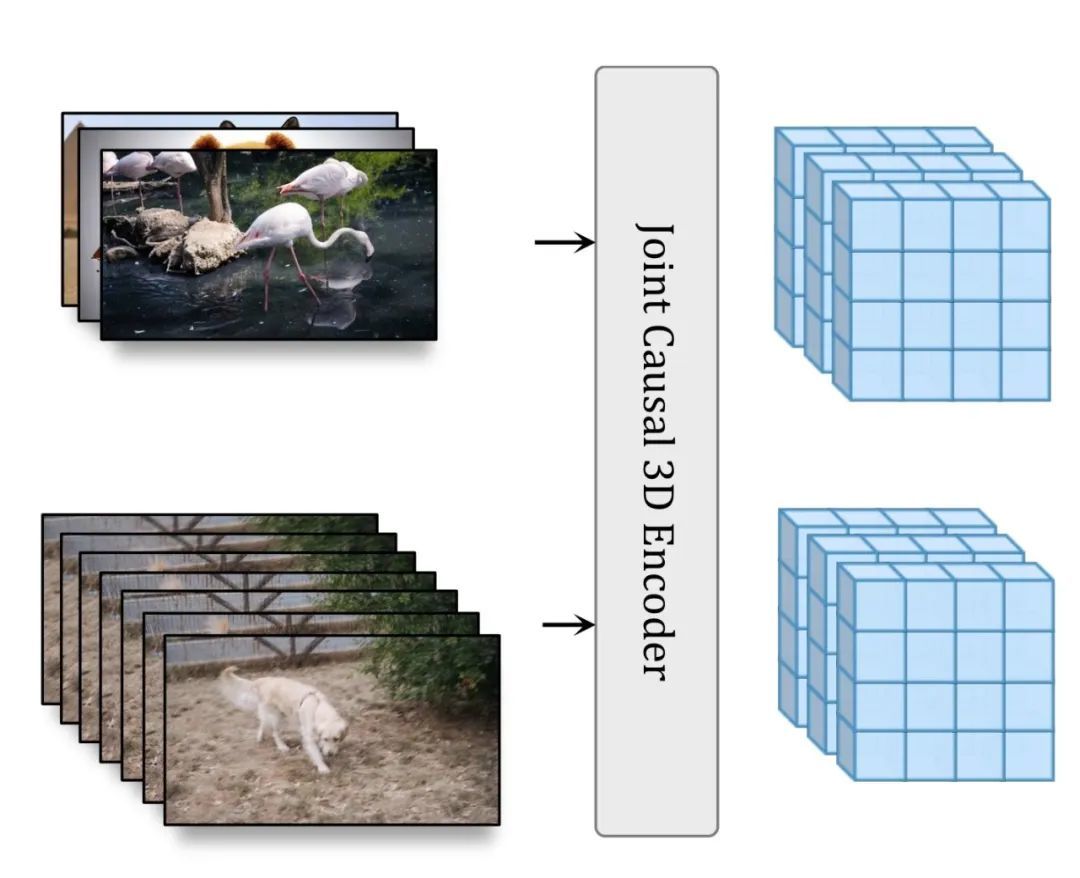

W.A.L.T模型目前支持文生视频、图片转视频和3D相机拍摄视频三项能力,团队展示了一系列W.A.L.T的生成示例。

1、文生视频:一句话生成高清逼真视频

输入一句简短的提示词,W.A.L.T模型就可以给出一个3秒长的逼真视频。以下是一些示例:

阳光明媚的下午,宇航员在喂鸭子。

一头戴着生日帽的大象在海滩上行走。

皮卡丘在拳击场内戴着拳击手套。

一只可爱的熊猫在天空中滑板,越过雪山,充满梦幻和异想天开的气氛。

一对情侣撑着雨伞走回家,倾盆大雨,油画风格。

2、图片转视频:用户提供图片,生成动态视频

这里的图片不是由W.A.L.T模型生成的,但动态效果是的,如下面的示例所示:

一个穿着全套太空服的宇航员骑着马,慢动作。

一个巨大的机器人在雪里行走。

一只大泰迪熊慢镜头走在第五大道上。

3、3D相机拍摄视频:物体全景多细节展示

团队还展示了3D视频内容的生成,效果看起来就像一个3D摄像机拍摄而来。示例如下:

镜头转向盘子里的汉堡,工作室。

摄像机绕着戴着一副耳机的南瓜,工作室灯光,360度旋转。

02 .

Transformer+潜在扩散模型,

降低计算成本

Transformer在处理视频等高维数据时成本过高,潜在扩散模型可以降低计算要求。

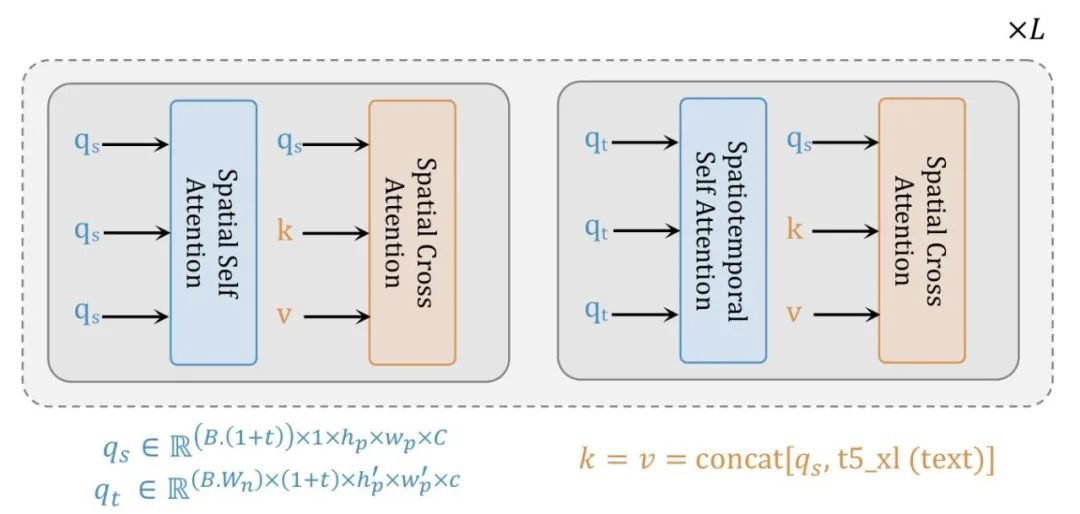

因此,李飞飞学生团队与谷歌研发者共同提出了窗口注意力潜在Transformer ,这是一种基于Transformer的潜在视频扩散模型方法。

当下,市面上的同类工具如Pika Labs推出的Pika 1.0、Runway的Gen-2,大都采用扩散模型,这是很长时间里图像和视频生成领域的主流技术路线。

W.A.L.T沿用这一主流技术路径,并在此基础上进行创新,主要实现以下两方面的升级:

1、使用局部窗口注意力,显著降低计算需求。

2、更有利的联合训练:空间层独立处理图像和视频帧,而时空层专注于时间关系建模。

据悉,这一架构主要的优势是它能同时在图像和视频数据集上进行训练。

这得益于W.A.L.T的两个关键决策:

1、使用因果编码器,在一个共享潜在空间中压缩图像和视频。

2、使用基于窗口注意力的Transformer架构,在潜在空间中联合时空生成建模,从而提高记忆和训练效率。

团队基于W.A.L.T训练了三个模型的级联,用于文本到视频的生成任务,包括:一个基本的潜在视频扩散模型、两个视频超分辨率扩散模型。

在无需使用无分类器指导的情况下,W.A.L.T在视频生成基准UCF-101和Kinetics-600、图像生成基准ImageNet测试上实现了SOTA。

▲在基于kinect-600的帧预测和基于UCF-101的类条件生成的视频生成评价

03 .

AI生成视频爆发,

巨头和创企都加码了

短短一个月时间里,AI生成视频赛道已成爆发态势,背后玩家不仅覆盖高校及科研团队,还有多家科技巨头及AI创企。

先是11月3日,视频生成领域的“老大哥”Runway宣布其AI视频生成工具Gen-2更新,分辨率提升至4K,大幅提高保真度和一致性。一周后,Runway又紧锣密鼓地发布了运动画笔功能,强化视频局部编辑能力。

Gen-2体验地址:

https://research.runwayml.com/gen2

▲Runway在X平台宣布其AI视频生成工具Gen-2更新

紧接着,国内外的科技巨头都加入了这一赛道。

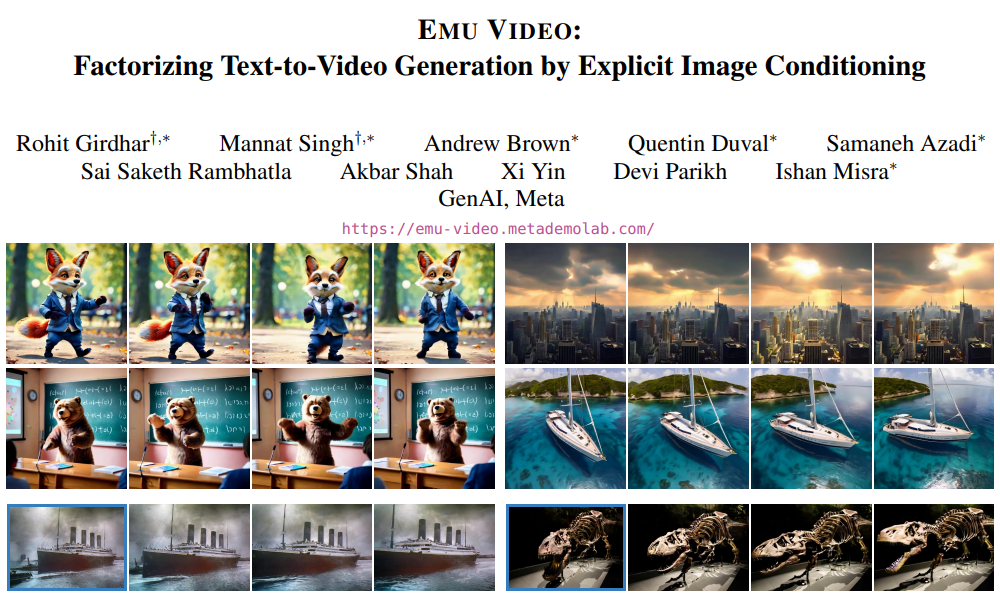

11月16日,科技巨头Meta推出了文生视频模型Emu Video。Emu Video可以通过自然语言生成高质量视频,它将视频生成分为两个步骤,首先生成以文本为条件的图像,然后生成以文本和生成的图像为条件的视频。

项目主页地址:

https://emu-video.metademolab.com

11月18日,国内大厂字节跳动推出了文生视频模型PixelDance,提出了基于文本指导+首尾帧图片指导的视频生成方法,使得视频生成的动态性更强。

项目主页地址:

https://makepixelsdance.github.io

▲PixelDance的强动态效果演示

一些AI创企的做法则更激进,直接扔出体验体验链接,引爆消费级市场。

11月29日,AI创企Pika Labs推出网页版Pika 1.0,一时间在消费级市场火出圈。Pika 1.0能根据文字图片,生成一段3s的流畅视频;它还支持用户圈定视频里的元素,进行视频局部编辑。Pika仅仅开放半年已有超50万用户,目前还有更多用户排队申请体验网页版Pika 1.0产品。Pika是一家创立于今年4月的创企,近期刚刚宣布了5500万美元融资。

Pika 1.0体验地址:

https://pika.art/waitlist

▲Pika Labs官宣网页版Pika 1.0上线

在图像领域深耕已久的Stability AI也不示弱。11月29日,Stability AI推出了名为Stable Video Diffusion的视频生成模型,提供SVD和SVD-XT两个模型。其中,SVD将静止图像转换为14帧的576x1024视频,而SVD-XT在相同的架构下将帧数提升至24。这两者都能以每秒3到30帧的速度生成视频,目前已进入“研究预览”阶段。

官方演示视频:

https://www.youtube.com/watch?v=G7mihAy691g

除此之外,国内美图公司发布的AI视觉大模型MiracleVision的4.0版本,刚刚新增了AI视频两大能力;来自中国科学院等机构的研究者在11月21日提出了一个无需训练的文本生成视频框架GPT4Motion;阿里的研究团队在最新论文中提出了新框架Animate Anyone,支持从静态图像AI生成动态视频。

商业化产品集中爆发,AI生成视频技术似乎正迎来一个“ChatGPT时刻”。

04 .

结语:技术和产品迭代扎堆,

AI视频生成赛道爆发

短短一个月时间里,我们看到AI视频生成的技术和产品加速爆发,科研机构、AI创企和科技巨头都出动了。

仅仅一年之前,ChatGPT以迅雷不及掩耳之势走向全球,为文本创作领域带来重大的变革,并掀起了全球范围内的“百模大战”。

一年后的今天,AI视频生成赛道或许迎来一个新的“ChatGPT时刻”,国内外的玩家都已经“开卷”了,推动多模态大模型的升维竞赛打响。

猜你喜欢

Guessyoulike